Cooper Lake SP & Barlow Pass: Intels CPUs finden Katzen-Bilder doppelt so schnell

Training und Inferencing laufen dank BF16-Unterstützung flotter, auch Intels persistenter Optane-Speicher wird zügiger.

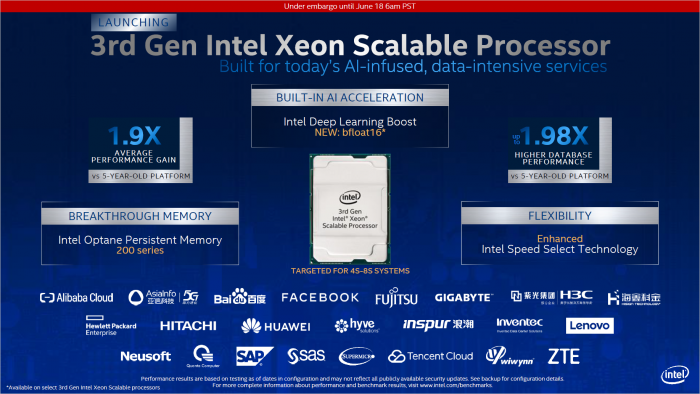

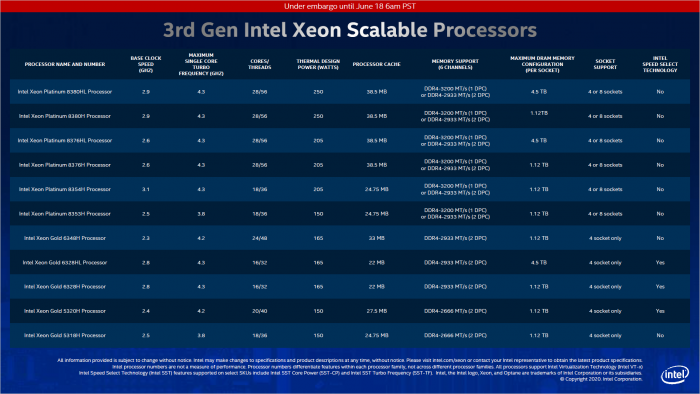

Intel hat die 3rd Gen Xeon Scalable alias Cooper Lake SP vorgestellt, vermarktet werden die Server-CPUs als Xeon Platinum 8300H(L) und als Xeon Gold 6300H(L)/5300H. Gedacht sind sie für Systeme, die mit künstlicher Intelligenz arbeiten, denn die Prozessoren nutzen das in diesem Segment beliebte BF16-Format für Training und Inferencing.

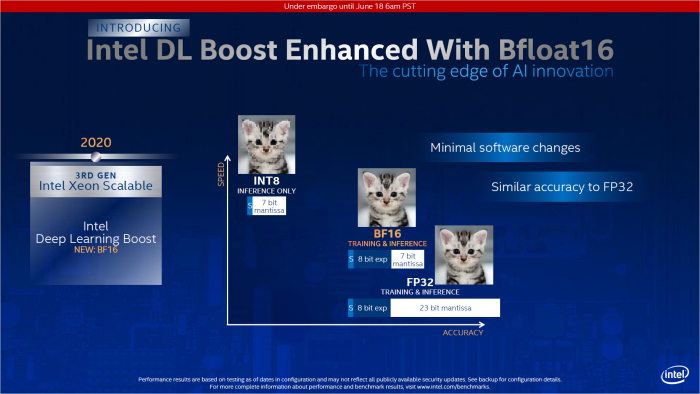

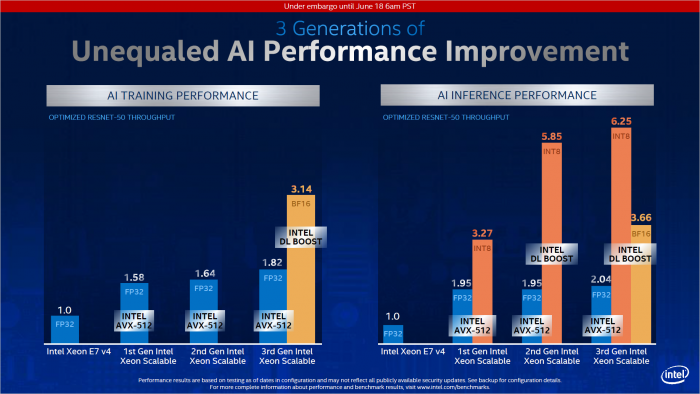

Der Marketing-Begriff seitens Intel lautet Deep Learning Boost, wobei darunter bisher schon eine Beschleunigung des INT8-Formats fiel. Die aktuellen Cascade Lake AP/SP unterstützen hierzu die vier VNNI (Vector Neural Network Instructions) für AVX-512, indem sie nur einen Taktzyklus statt drei für entsprechende Matrix-Multiplikationen benötigen. Die Cooper Lake führen dieses Prinzip bei BF16 fort, verglichen zu FP32 verdoppelt sich die Leistung theoretisch.

BF16 ist ein Gleitkomma-Format mit 8 Bits für den Exponenten und 7 Bits für die Mantisse. Dadurch steigt die Geschwindigkeit gegenüber FP32 bei geringerer Präzision, wohingegen INT8 deutlich schneller bei erneut niedrigerer Genauigkeit rechnet. Für Deep Learning ist das Format daher interessant, da es für Training und Inferencing eingesetzt werden kann. Intel selbst unterstützt BF16 bereits mit dem eigenen KI-Beschleuniger von Habana Labs und Nervana, auch die TPUs von Google beherrschen den Umgang mit BF16.

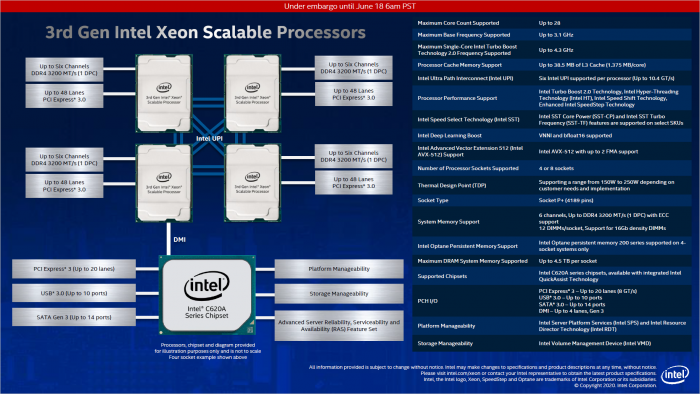

Während die Cascade Lake SP respektive die Purley-Plattform primär für 2-Sockel-Server gedacht ist, positioniert Intel die Cedar-Island-Plattform mit Cooper Lake (CPX6) rein für Systeme mit vier oder acht Sockeln und von drei auf sechs verdoppelten QPI-Links (je 10,4 GT/s) pro CPU. Die Fassung LGA 4189 weist sechs Speicherkanäle für bis zu DDR4-3200 (1DPC) statt DDR4-2933 auf, zudem unterstützen die Cooper Lake auch die zweite Generation des Optane DC Persistent Memory alias Barlow Pass - dazu gleich mehr. Im Vollausbau haben die 14-nm-Server-CPUs bis zu 28 Kerne und 56 Threads sowie 48 PCIe-Gen3-Lanes, da es sich um leicht überarbeitete Cascade Lake SP handelt. Tatsächlich werden die Cooper Lake schon seit vielen Monaten von Facebook eingesetzt.

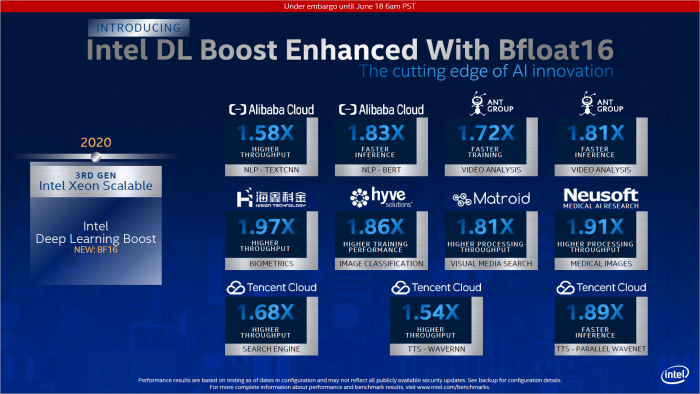

Mittlerweile will Intel weitere Partner für die CPUs haben - darunter Alibaba, Ant Group, Hisign Technology, Hyve Solutions, Matroid, Neusoft und Tencent. Dank BF16-Unterstützung sollen unter anderem Computerlinguistik für Satzbau- oder Spracherkennung sowie Foto- und Videoanalyse, aber auch Biometrie-Berechnungen und Suchmaschinen um den Faktor 1,58 bis 1,97 beschleunigt werden. Wie schon bei den Cascade Lake SP gibt es auch bei den Cooper Lake das sogenannte Speed Select, genauer SST-BF (Base Frequency) für mehr Basistakt und SST-CP (Clock Priority) für mehr Takt bei Kernen mit priorisierten Tasks.

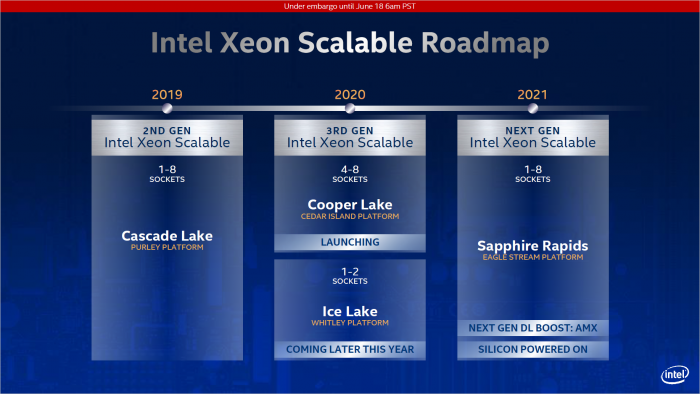

Neben Cooper Lake gab Intel auch einen Ausblick auf kommende Server-CPU-Generation: Noch 2020 sollen die Ice Lake SP mit bis zu 38 Kernen im 10-nm-Verfahren erscheinen. Sie passen in die Fassung LGA 4189, haben acht Speicherkanäle, nutzen PCIe Gen4 und sind für 2-Sockel-Systeme ausgelegt. 2021 folgen dann die Sapphire Rapids, hier wechselt Intel auf die Fassung LGA 4677, da die Chips ein achtkanaliges Interface für DDR5-Speicher aufweisen und PCIe Gen5 beherrschen. Sapphire Rapids unterstützt die AMX (Advanced Matrix Extensions) für schnelle Matrizen-Multiplikationen mit BF16 und INT8.

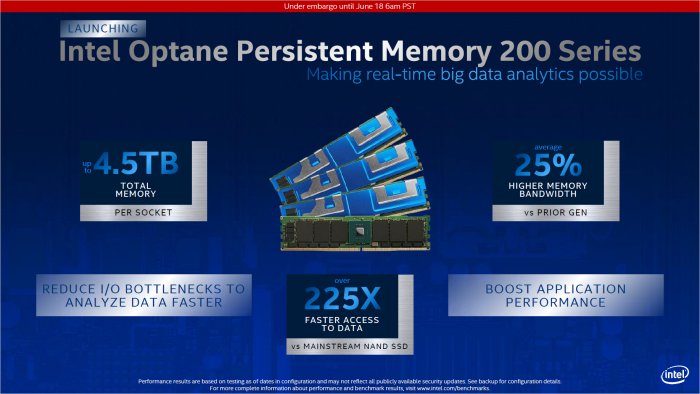

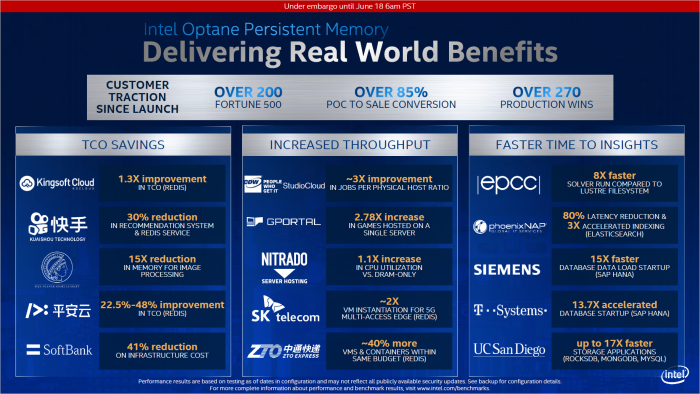

Cooper Lake und Ice Lake unterstützen den bereits erwähnten nicht flüchtigen Optane DC Persistent Memory 200 alias Barlow Pass: Mit sechs 256-GByte-DDR4- und sechs 512-GByte-Optane-Riegeln pro Sockel sind 4,5 TByte pro Sockel bei den HL-Modellen möglich. Die L-Ableger erreichen 1,12 TByte pro Sockel durch sechs 64-GByte-DDR4- und sechs 128-GByte-Optane-Module. Barlow Pass ähnelt bisherigen Optane DC Persistent Memory 100 alias Apache Pass, selbst die Anzahl und Kapazität der Speicherchips ist identisch; gleiches gilt für die bis zu 18 Watt pro Riegel. Optimierungen am Controller und bei der Fertigung sollen jedoch die Datentransfer-Rate um durchschnittlich 25 Prozent anheben.

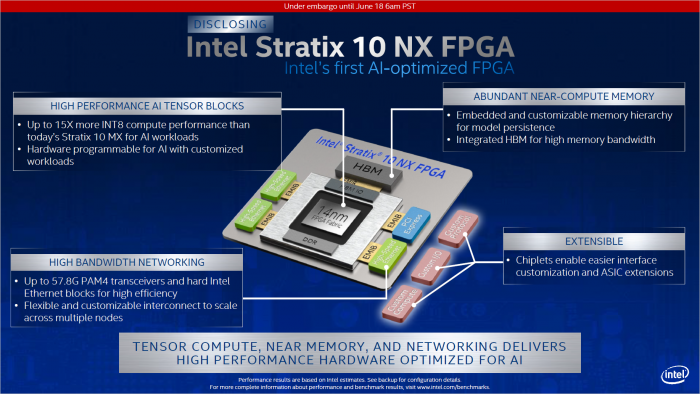

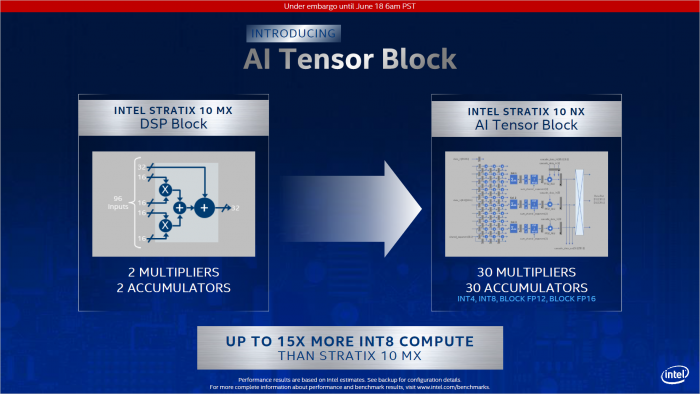

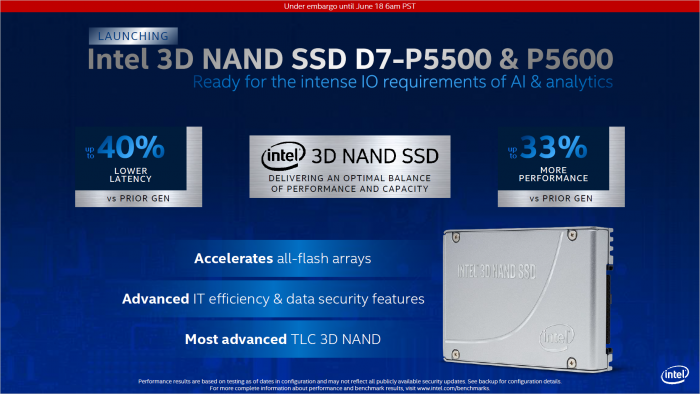

Abseits von Cooper Lake und Barlow Pass hat Intel noch einen FPGA namens Stratix 10 NX vorgestellt. Das Design nutzt HBM2-Speicher und integriert Tensor-Einheiten, welche die INT8-Geschwindigkeit um das 15-Fache steigern. Zu den ersten Partnern gehört Microsoft für die eigene AI-Cloud. Ebenfalls neu sind U.2-SSDs namens Arbordale Plus, genauer die D7-P5600 und die D7-P5500. Beide nutzen PCIe Gen4 und sind für Datacenter gedacht, Intel verwendet den 3D-NAND-Flash v3 mit 96 Schichten und drei Bit pro Zelle (TLC).

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

| CPU | Node | Kerne | Sockel | RAM-Kanäle | PCIe | Launch | |

|---|---|---|---|---|---|---|---|

| Nehalem EP | Xeon W5590 | 45 nm | 4 | LGA 1366 | 3x DDR3-1333 | 36x Gen2 | 2009 |

| Westmere EP | Xeon X5690 | 32 nm | 6 | LGA 1366 | 3x DDR3-1333 | 36x Gen2 | 2010 |

| Sandy Bridge EP | Xeon E5-2690 | 32 nm | 8 | LGA 2011 | 4x DDR3-1600 | 40x Gen2 | 2012 |

| Ivy Bridge EP | Xeon E5-2690 v2 | 22 nm | 10 | LGA 2011 | 4x DDR3-1866 | 40x Gen3 | 2013 |

| Haswell EP | Xeon E5-2699 v3 | 22 nm | 18 | LGA 2011-3 | 4x DDR4-2133 | 40x Gen3 | 2014 |

| Broadwell EP | Xeon E5-2699 v4 | 14 nm | 22 | LGA 2011-3 | 4x DDR4-2400 | 40x Gen3 | 2016 |

| Skylake SP | Xeon 8180M | 14+ nm | 28 | LGA 3647 | 6x DDR4-2666 | 48x Gen3 | 2017 |

| Cascade Lake SP | Xeon 8280M | 14++ nm | 28 | LGA 3647 | 6x DDR4-2933, Optane | 48x Gen3 | 2019 |

| Ice Lake SP | Xeon 8380 | 10 nm | 40 | LGA 4189 | 8x DDR4-3200, Optane v2 | 64x Gen4 | 2021 |

| Sapphire Rapids SP | (?) | Intel 7 | 56 | LGA 4677 | 8x DDR5, Optane v3 | Gen5 | 2022 |

| Emerald Rapids SP | (?) | Intel 7 | 64 | LGA 4677 | 8x DDR5, Optane v3 | Gen5 | 2023 |

| Granite Rapids SP | (?) | Intel 3 | (?) | LGA 4677 | 8x DDR5, Optane v4 | Gen5 | 2024 |

| Sierra Forest SP | (?) | Intel 3 | (?) | (?) | (?) | (?) | 2025 |

| Diamond Rapids SP | (?) | (?) | (?) | (?) | (?) | (?) | 2025 |

Dass sowohl Facebook, als auch die Überwachungsbehörden es können, ist unzweifelhaft...