Google: Deep-Learning-System analysiert Augenscans nach Krankheiten

Mit genug Referenzmaterial kann ein Deep-Learning-Algorithmus von Googles Tochter Verily verschiedene Eigenschaften von Patienten bestimmten, etwa das Alter, das Geschlecht oder das Risiko einer Herz-Kreislauf-Erkrankung. Die Genauigkeit ist schon jetzt mit traditionellen Methoden vergleichbar.

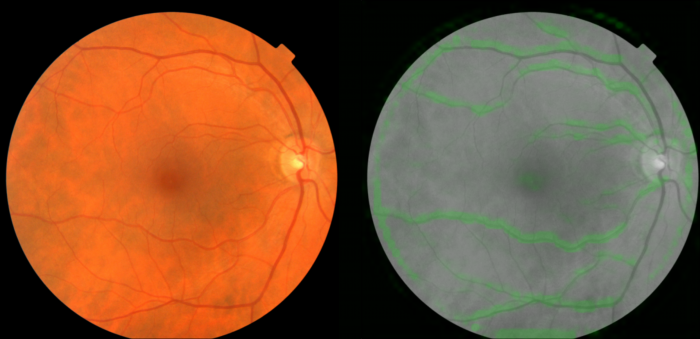

Forscher von Googles Tochterunternehmen Verily haben einen Deep-Learning-Algorithmus entwickelt, der anhand von Augenhintergrundscans Krankheitsbilder erkennt. Damit soll beispielsweise die aktuell häufigste Todesursache eines Herz-Kreislauf-Versagens besser diagnostiziert werden können. Der Algorithmus vergleicht die Bilder, die verschiedene Institute von ihren Patienten gemacht haben.

Laut der Veröffentlichung im Magazin Nature Biomedical Engineering besteht die Referenzmenge aus fast 1,8 Millionen Bildern von knapp 300.000 Patienten. Anhand dieser kann der Algorithmus diverse Eigenschaften erkennen: das Alter der Patienten, deren Geschlecht, deren Blutdruck oder ob diese rauchen. Aus diesen Parametern kann das Risiko für eine Herzkrankheit ermittelt werden. Der Blutdruck wird etwa durch die Stärke der auf den Bildern zu sehenden Adern ermittelt.

An einigen Stellen genauer als traditionelle Methoden

Anhand der Referenzbilder konnte das Deep-Learnig-System mit 70 Prozent Genauigkeit den Unterschied zwischen einem an Herz-Kreislauf-Störungen leidenden Patienten und einem gesunden Patienten erkennen. Die traditionelle, Score genannte Methode ist mit 72 Prozent nur wenig genauer, heißt es in der Veröffentlichung. In einigen Aspekten sei die Software sogar genauer. Beim Analysieren des Patientenalters konnte der Algorithmus mit 78 Prozent Genauigkeit das Alter in einem Intervall von plus/minus fünf Jahren bestimmen. Traditionelle Analysen schaffen das nur zu 44 Prozent.

Trotzdem sind die Forscher noch vorsichtig: Das Deep-Learning-Modell ist noch in einem recht frühen Entwicklungsstadium. Für eine genaue Analyse fehlt es noch immer an genug Referenzmaterial - trotz 1,8 Millionen Bildern. Außerdem sei das verwendete Sichtfeld der Aufnahmen von 45 Grad ein einschränkender Faktor. In einigen Jahren könnte ein solches System jedoch die medizinische Arbeit von Ärzten erleichtern und genauer machen.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

"Menschen immer mehr kategorisieren, nach Alter, Geschlecht und Krankheiten. Schöne neue...

Man geht zum Arzt, schaut in einen Augenscanner und der Computer sagt einem was Sache...