Nvidias GV100-Chip: "Wir sind am Limit des technisch Möglichen"

Die neue Volta-GPU ist so monströs, dass Nvidia beim Auftragsfertiger TSMC einen eigenen Herstellungsprozess nutzt und sogar die Grenzen der Maske sprengt. Dafür verantwortlich sind große Caches und die wohl riesigen Tensor-Cores.

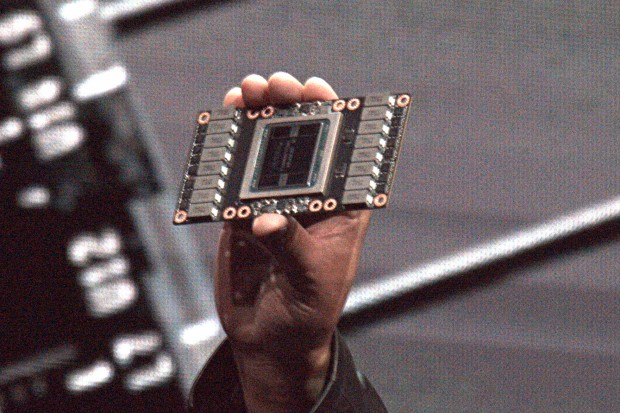

Nvidia hat auf der GPU Technology Conference 2017 im kalifornischen San Jose weitere Details zum GV100-Chip mit Volta-Architektur verraten. Die GPU wird vorerst für drei Rechenbeschleuniger, den Tesla V100, mit Fokus auf Deep Learning eingesetzt: Einem SXM2-Modul mit Mezzanine-Anschlüssen und 300 Watt TDP, einer klassischen PCIe-Steckkarte mit 250 Watt und einem 150-Watt-Ableger davon. Um die reduzierte Leistungsaufnahme zu erreichen, drosselt Nvidia die Taktraten, die Anzahl der Shader-Einheiten bleibt gleich.

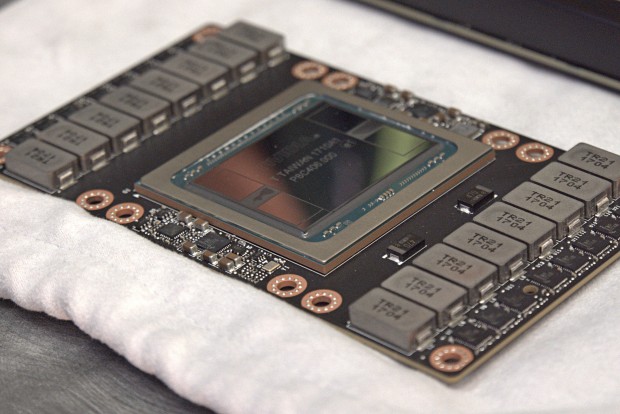

Mit einer Fläche (Die-Size) von 815 mm² ist der GV100 die größte je gebaute GPU. Um einen solchen Chip zu realisieren, kommt das 12FFN-Verfahren von TSMC zum Einsatz. Das steht für 12 nm FinFET Nvidia, da eine modifizierte 16-nm-Variante für eine höhere Transistordichte und bessere Effizienz entwickelt wurde. Der Interposer, auf welchem der GV100 und die vier HBM2-Speicherstapel sitzen, sprengt die Dimensionen der Maske (Reticle), weshalb für ihn zwei Belichtungsdurchgänge benötigt werden.

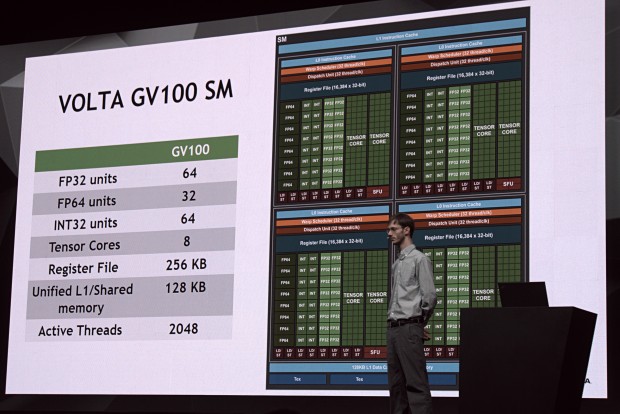

Auf die obligatorische Frage nach der Chipausbeute (Yield) antwortete Nvidia, dass die Lieferung Abertausender von Tesla V100 belege, dass die GV100-GPU in Serie produzierbar sein. Den scherzhaften Kommentar, wie viele Wafer pro funktionierendem Chip notwendig seien, sorgte dementsprechend für ein breites Grinsen bei Nvidias Jonah Alben. Der Senior VP of GPU Engineering erläuterte anschließend, dass die neuen Tensor-Cores, die unter anderem für die drastisch gestiegene FP16-Rechenleistung verantwortlich sind, viel Platz benötigen. Relative Angaben wollte Alben aber lieber keine machen.

Zu den Verbesserungen des GV100-Chips gehört der L1-Cache. Der weist 128 statt 24 KByte auf und erreicht die vierfache Bandbreite. Weil er mit dem Shared Memory (der auf bis zu 96 der 128 KByte konfigurierbar ist) vereint wurde, sinkt die Latenz und die Programmierbarkeit wird einfacher. Volta unterscheidet sich bei den verdoppelten Schedulern und der Ausführung von Threads massiv von Pascal, die ISA und das SIMT-Modell sind ein anderes.

Obgleich Nvidia den GV100 aufgrund seiner FP64- und FP16-Leistung in erster Linie im Profisegment positioniert, eignet sich der Chip auch als Basis für eine Quadro-Workstation- oder Geforce-Gaming-Grafikkarte.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

Mein Gott, haben wir inzwischen Luxus-Probleme! :-D

"Oger haben Schichten..."

nMP? New Mac Pro? Wie um alles in der Welt hast du AMD dazu bekommen die W9000 für den...

Selbst wenn es einmal ein Material geben sollte, welches die notwendigen supraleitenden...