AI-Beschleuniger: Nvidias Tesla V100 nutzt 815-mm²-Volta-Chip

Nvidia hat die Tesla V100 angekündigt, eine für Deep-Learning gedachte Beschleunigerkarte mit Volta-GPU. Die ist absurd groß, weist 5.376 Shader-Einheiten auf und beherrscht neue Tensor-Op-Instruktionen für Training und Inferencing.

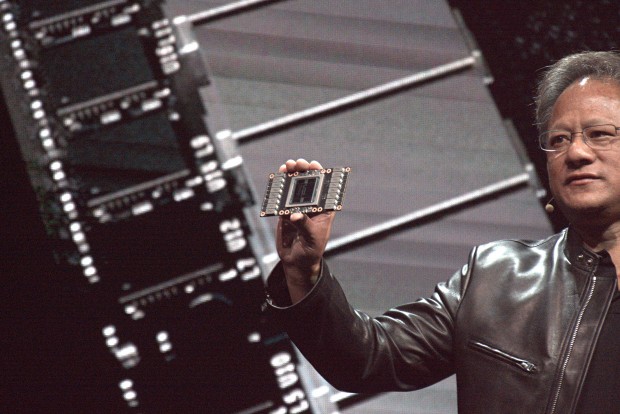

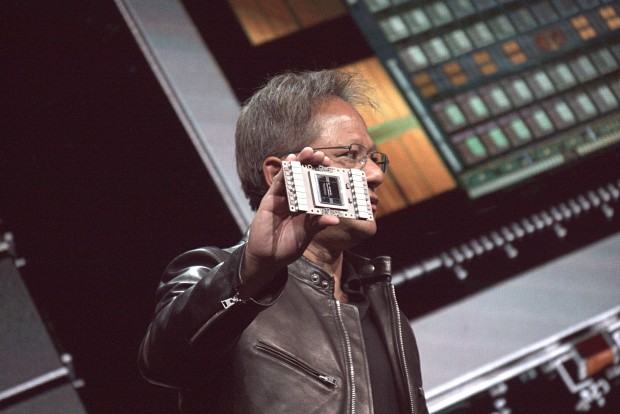

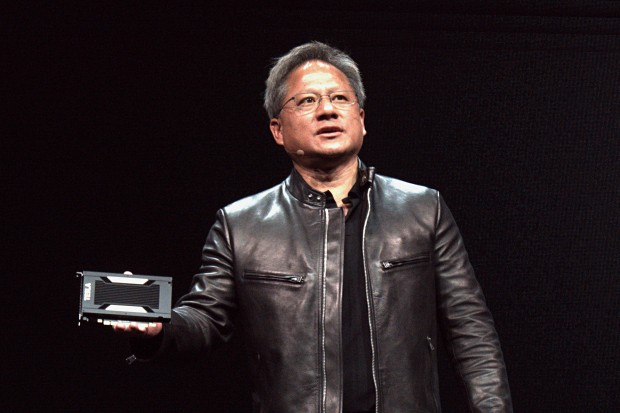

Nvidia-Chef Jen-Hsun Huang hat auf der GPU Technology Conference 2017 im kalifornischen San Jose die Tesla V100 vorgestellt. Das neue Beschleunigermodul basiert auf der Volta-Architektur und ist für Cloud-Plattformen, Deep Learning und künstliche Intelligenz ausgelegt. Laut Huang war der zugrunde liegende Chip das komplexeste Produkt seiner Karriere, was die technischen Daten der GV100 genannten GPU mit 5.376 Rechenkernen unterstreichen.

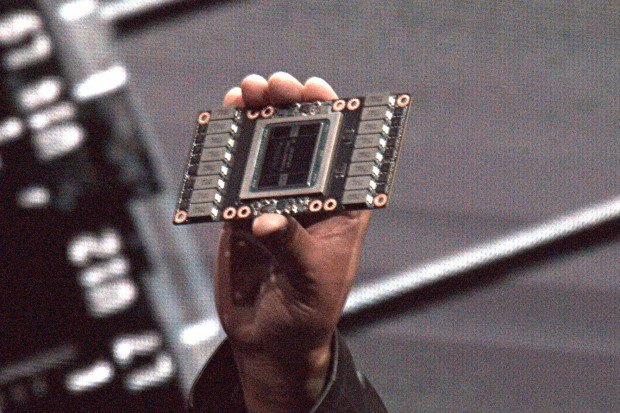

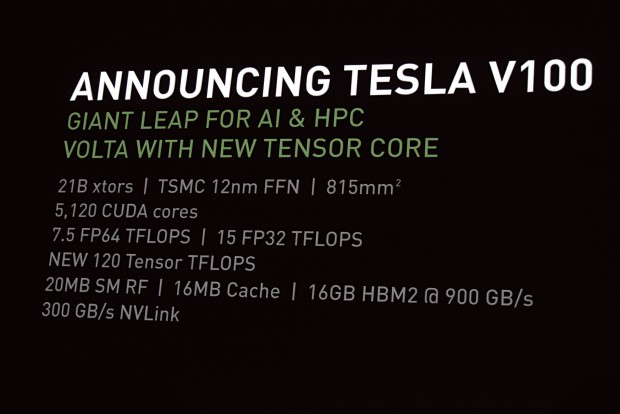

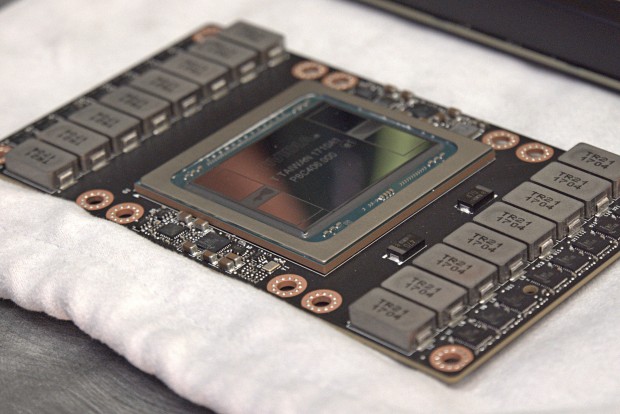

Der Chip misst 815 mm² und damit der größte der bisher in Serie gefertigt wurde. Er wird bei der TSMC im 12-nm-FinFET-Verfahren produziert, einem verbesserten 16-nm-Node. Das erklärt die enormen Abmessungen, welche das Limit dessen darstellen dürften, was technisch noch möglich ist. Die GPU integriert 21,1 Milliarden Transistoren und weist 5.120 aktive Shader-Einheiten bei 1.455 MHz sowie 300 Watt TDP auf. Zum Vergleich: Der auf der GTC 2016 vorgestellte GP100-Chip der Tesla P100 kommt auf 15,3 Milliarden Transistoren auf 610 mm² für 3.840 ALUs bei 1.480 MHz und 300 Watt TDP.

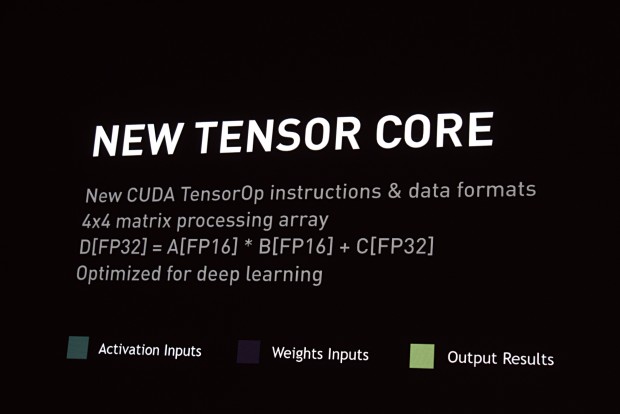

Einer der Gründe für die Maße sind die satten 20 MByte an Registerspeicher, hinzu kommen 10 MByte L1- und 6 MByte L2-Cache. Diese sehr großen Zwischenpuffer ermöglichen es Nvidia mehr Daten lokal vorzuhalten, wodurch die Geschwindigkeit steigt. Die theoretische Rechenleistung beträgt 15 Teraflops bei einfacher Genauigkeit (FP32) und 7,5 Teraflops bei doppelter Genauigkeit (FP64). Zu beschleunigtem INT8 äußerte sich Nvidia nicht, stattdessen beherrscht die Tesla V100 sogenannte Tensor-Op-Instruktionen für FP16 und FP32.

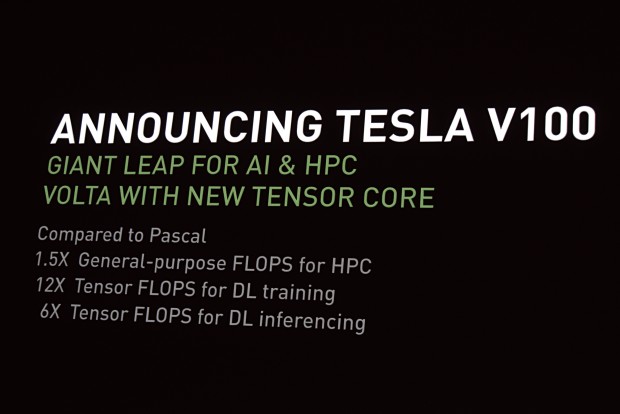

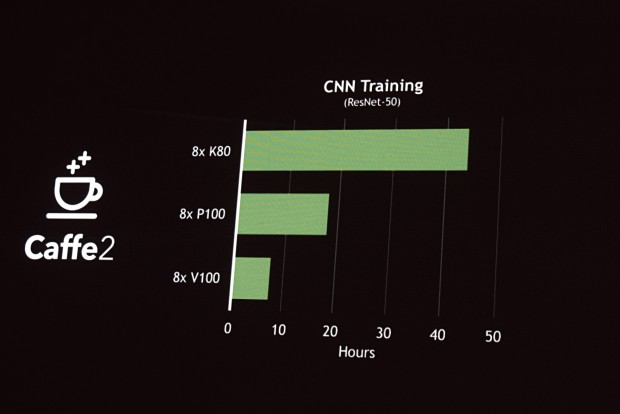

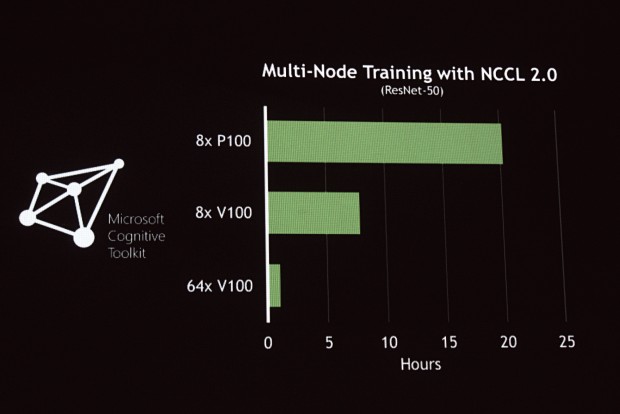

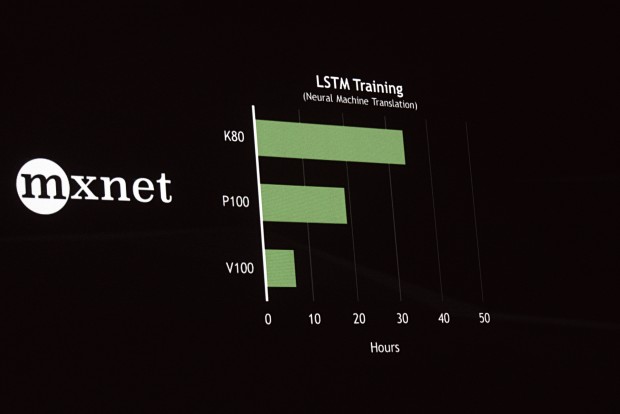

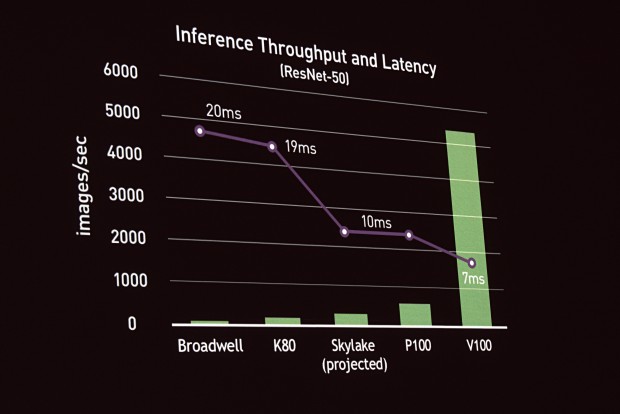

Hierzu verbaut Nvidia 672 dedizierte Tensor-Cores (640 in der V100), die 4x4- Matrizen mit FP16-Input und FP32-Output per FMA berechnen. Das macht 64 FLOPS pro Taktzyklus und Tensor-Kern und somit 120 Teraflops im Falle der Tesla V100. Die Instruktion soll Training um Faktor 12 und Inferencing um Faktor 6 verglichen mit der älteren Tesla P100 beschleunigen. Die FP32-/F64-Leistung steigt mit Tesla V100 um gut 40 Prozent. Der Speicherausbau der neuen Karte beläuft sich auf 16 GByte HBM2, die Transferrate liegt aber bei 900 statt 720 GByte die Sekunde. Mehrere Tesla V100 lassen sich per NV-Link 2.0 koppeln: Die Bandbreite pro Link liegt bei 25 statt 20 bidirektionale GByte die Sekunde, zudem gibt es sechs statt vier Verbindungen, also 300 statt 200 GByte/s.

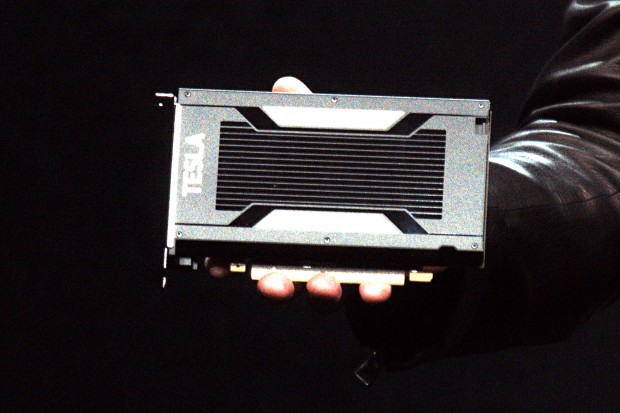

Neben dem SXM2-Modul mit Mezzanine-Anschlüssen plant Nvidia auch eine Tesla V100 für Inferencing. Diese PCIe-Karte in FHHL-Bauweise (Full Height Half Length) benötigt 150 Watt. Leistungsangaben gibt es nicht, der Beschleuniger soll aber um bis zu Faktor 20 schneller sein als Intels neue Skylake-SP mit AVX512. Das gilt freilich nur bei Inferencing und ist ein geschätzter Wert.

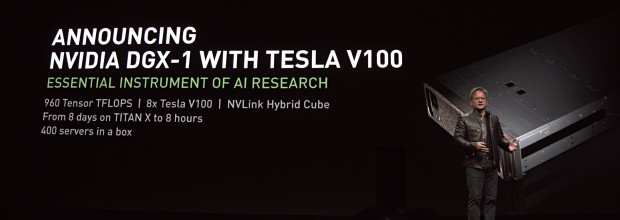

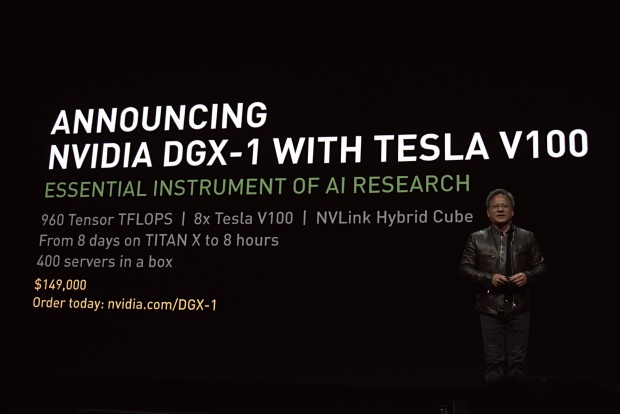

Die Tesla V100 möchte Nvidia ab dem vierten Quartal 2017 ausliefern. Wer früher ein Modell benötigt, muss zu einem aktualisierten DGX-1- oder HGX-1-System oder der neuen wassergekühlten DGX-Station greifen.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

Nvidia hat unter anderem mal dreist ein Holzmodell einer Graphikkarte auf einer Messe...

orientieren sich stark an der intel Enterprise-Strategie.

Die verschiedenen Netz-Layer verarbeiten die Daten auf verschiedenen Abstraktionsebenen...

Da musste ich sofort an diesen Film denken...