Google Brain: Algorithmus macht Gesichter auf schlechten Bildern erkennbar

Der Traum der Kriminalisten: Googles Entwicklungsabteilung Google Brain hat einen Algorithmus geschaffen, der Inhalte aus niedrig aufgelösten Bildern hochrechnen kann. Für die Fahndung eignen sich diese Bilder allerdings kaum.

Eine bekannte Krimiszene: Ein Bildschirm, ein kaum erkennbares Bild, und der Kommissar fragt den Computerexperten: "Können Sie das schärfer machen?" Meist zeigt das Bild ein Gesicht, das von einer Überwachungskamera aufgenommen wurde - bei wenig Licht und in geringer Auflösung. Und der Fahnder will wissen, wen es zeigt. Im Film kann der Computerexperte helfen und das Bild scharf rechnen. Im richtigen Leben macht das jetzt Google.

Die Abteilung Google Brain hat ein System entwickelt, das in der Lage ist, sehr niedrig aufgelöste Bilder zu verbessern. Dazu haben die Google-Entwickler zwei neurale Netze miteinander kombiniert. Die analysieren das Bild und verbessern es.

Das neurale Netz vergleicht Bilder

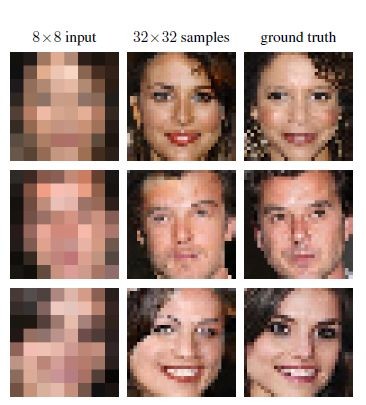

Natürlich ist es nur möglich, Informationen, die im Bild vorhanden sind, zu verbessern. In den 8 x 8 Pixel großen Bildern gibt es aber kaum Informationen. Das erste neurale Netz vergleicht deshalb das niedrig aufgelöste Bild mit einem Archiv von höher aufgelösten Bildern. Diese werden ebenfalls auf 8 x 8 Pixel heruntergerechnet. Dann vergleicht das System das Ergebnis mit dem Ausgangsbild.

Das zweite System versucht, die fehlenden Details auf dem 8 x 8 Pixel großen Ausgangsbild hinzuzufügen. Auch dieses neurale Netz zieht wieder höher aufgelöste Bilder zum Vergleich heran. Hat das erste System erkannt, dass das kleine Bild ein Gesicht darstellt, vergleicht es das zweite System mit gespeicherten Gesichtern und ergänzt es dann.

Der Algorithmus ergänzt Details

Findet der Algorithmus beispielsweise in dem Minibild im oberen Bereich eine dunkle Stelle, schließt es daraus, dass es sich dabei um eine Augenbraue handeln könnte. Beim Hochrechnen baut es an dieser Stelle also Augenbrauen-Pixel ein.

Die Ergebnisse der beiden Systeme werden schließlich zusammengeführt und daraus wird dann ein Bild mit 32 x 32 Pixel errechnet. Die Ergebnisse sind erstaunlich: Aus einem 64 Pixel großen Bild, auf dem kaum etwas zu erkennen ist, macht das System erkennbar ein Gesicht.

Das rekonstruierte Gesicht ist nicht das echte Gesicht

Für den Kommissar ist das aber nicht unbedingt die Lösung seines Problems, auf einem unscharfen, verpixelten Bild einen Verdächtigen zu erkennen. Denn das Google-System kann auch nur mit den Daten arbeiten, die es hat - dem Original und einem Datensatz zum Vergleich. Daraus extrapoliert es dann ein Gesicht, das dem der Person auf dem Bild wahrscheinlich nur entfernt gleicht - und den Kommissar dazu bringen könnte, nach einer Person zu fahnden, die es gar nicht gibt.

Wenn das System mit der Zeit besser wird, kann es möglicherweise wirklich Menschen wieder erkennbar machen. Damit wiederum würde Google die eigenen Bemühungen um den Schutz der Privatsphäre unterlaufen: Vor einigen Jahren hat das Unternehmen eigens ein System entwickelt, das Gesichter in den Bildern von Google Street View verwischt. Was, wenn das neue System diese wieder erkennbar macht?

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

Oh, stimmt! Faszinierend.

Quelle? Ich glaube nicht einfach irgendwas, was irgendwer einfach so behauptet.

Und im unteren Bild hat der Algorithmus weiße Pixel gesehen, und daraus geschlossen...

So wie ich das verstehe, dürfte es dasselbe Prinzip sein: "In addition to that the loss...