P40 und P4: Nvidia veröffentlicht ungewöhnliche Tesla-Beschleuniger

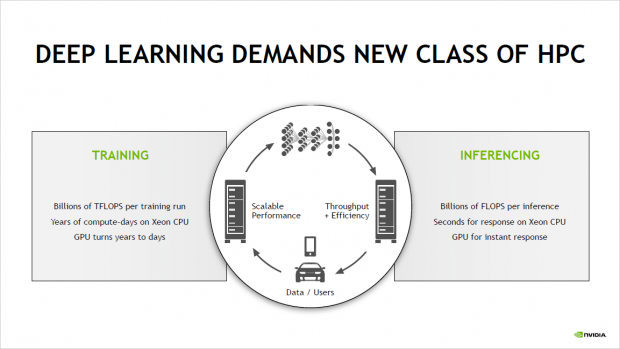

Einmal schneller Vollausbau und einmal extrem effizient: Die Tesla P40 und die Tesla P4 sind für Deep Learning gedacht, da Nvidia bei den Beschleunigerkarten eine wichtige Funktion freigeschaltet hat.

Nvidia-Chef Jen-Hsun Huang hat auf der GPU Technology Conference im chinesischen Peking zwei neue Tesla-Beschleuniger vorgestellt: die Tesla P40 und die Tesla P4, die beide auf der aktuellen Pascal-Grafikarchitektur basieren. Sie sind für Inferencing gedacht, also den Schritt nach dem Training eines neuronalen Netzes, wie es etwa für Bilderkennung verwendet wird.

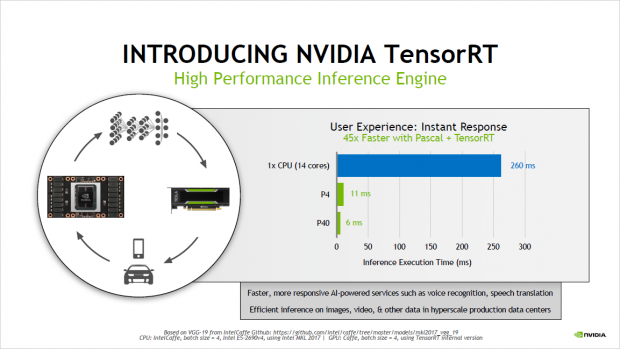

Für das vorab erfolgende Training ist eine enorm hohe Rechenleistung bei entsprechender Genauigkeit erforderlich, sie liegt Nvidia zufolge bei mindestens FP16 (Floating Point, Half Precison). Die Maxwell-v2-Generation in Form der Tesla M40 und Tesla M4 beherrscht rein von der Hardware her minimal FP32, was für Deep Learning nicht notwendig ist. Die Tesla P40 und die Tesla P4 hingegen beschleunigen INT8-Operationen (Integer, Quarter Precison) pro Takt und Shader auf die vierfache Geschwindigkeit einer FP32-Operation, was laut Nvidia wiederum für Inferencing ausreichend ist.

Die Tesla P40 basiert auf dem GP102-Chip, den Nvidia auch für die Titan X und die Quadro P6000 einsetzt. Die neue Beschleunigerkarte nutzt einen Vollausbau mit 3.840 Rechenkernen bei 1.303/1.531 MHz (Basis/Boost) und einem Speichertakt von 3,6 GHz. Die 24 GByte sind mit 384 Bit angeschlossen. Nvidia gibt für die passiv gekühlte Karte eine Verlustleistung von 250 Watt an. Statt GDDR5X wird GDDR5 verwendet, was für INT8 wohl ausreicht.

Spannend ist die Tesla P4 im Low-Profile-Format, denn Nvidia taktet den verbauten GP104-Chip extrem niedrig: Der ist von der Geforce GTX 1080/1070 bekannt und läuft dort samt Boost mit meist 1,7 GHz aufwärts. Die neue Beschleunigerkarte dagegen weist eine Frequenz von sehr niedrigen 810/1.063 MHz auf. Das erklärt auch die TDP von 50 bis 75 Watt je nach eingestelltem Power-Limit. Das macht die Tesla P4 trotz GDDR5 extrem effizient.

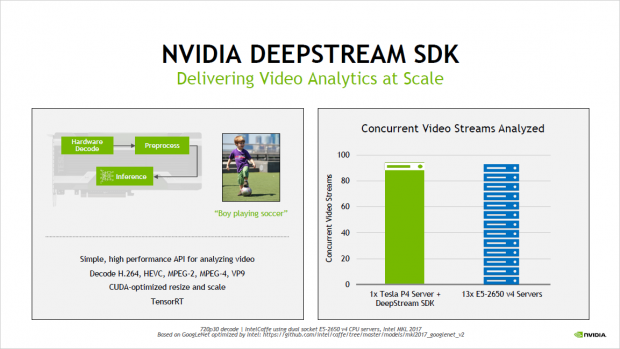

Parallel zur Hardware hat Nvidia die TensorRT-Bibliotek, zuvor als GPU Inference Engine bekannt, und das Deepstream SDK vorgestellt. Erstere soll Entwicklern helfen, trainierte Netze von FP16/FP32 auf INT8 anzupassen und Letzteres ist eine Schnittstelle, um Videos zu analysieren. Die beiden Tesla-Beschleuniger sollen im Oktober und November 2016 erscheinen.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

Streiche einfach das T.

Ich glaube es wird einfach ein viertel Integer gemeint sein also 8Bit. Die Precision...

Das ist halt das Problem, je näher man an die Perfektion will, um so schneller steigt der...