Pascal-Grafikchip: Benchmarks und Details zum GP100

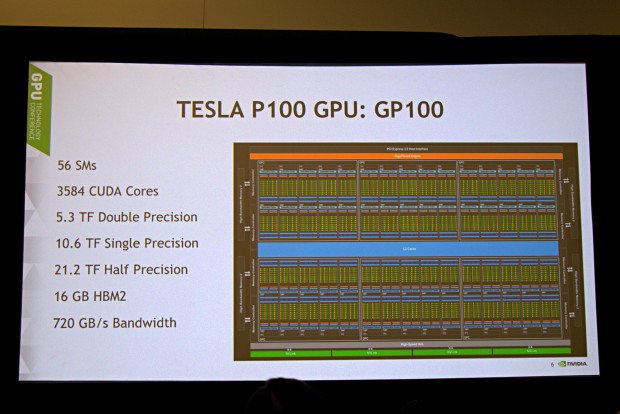

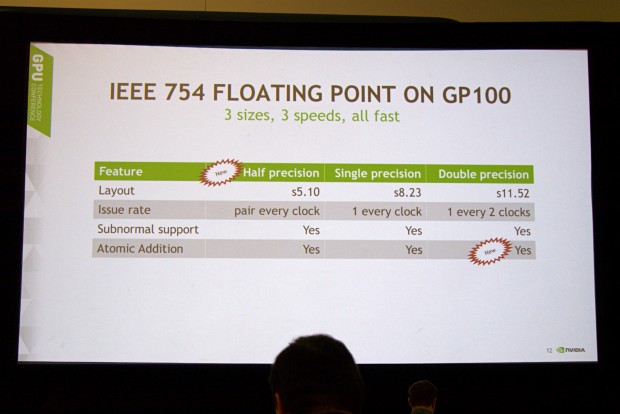

Nvidia hat ein paar zusätzliche Informationen zum GP100-Chip und der Tesla P100 mit Pascal-Technik verraten: Das Package ist für 32 statt 16 GByte HBM2-Speicher vorbereitet, was für künftige Modelle interessant wird. Erste Benchmarks zeigen, dass der Beschleuniger wie erwartet vor allem bei FP16- und FP64-Berechnungen stark ist.

Nvidia hat auf der GPU Technology Conference 2016 in San Jose, Kalifornien weitere Details und erste Messwerte zum GP100-Grafikchip und dem darauf basierenden Rechenbeschleuniger Tesla P100 bekannt gegeben. Im Nachgang der Keynote von CEO Jen-Hsun Huang gab es eine kurze Q&A mit Jonah Alben, Senior Vice President von GPU Engineering, und eine Deep-Dive-Session über die neue Pascal-Architektur. Die pickte sich aber nur einige Informationen aus dem Blog-Eintrag heraus und ließ daher Fragen offen.

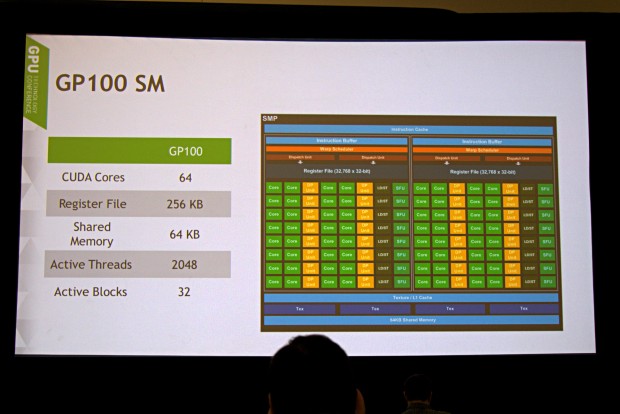

Interessant war hierbei ein rudimentäres Blockdiagramm des GP100-Chips: Zwar fehlen dort die Raster- und die für Tessellation wichtigen Polymorph-Engines, dafür wird der Aufbau der sechs Graphics Processor Cluster klarer. Jeder enthält fünf TPCs - diese Bezeichnung verwendete Nvidia zuletzt beim G80, damals stand sie für Texture Processor Cluster. Pro TPC gibt es zwei Streaming Multiprocessors (SMP), die in zwei Blöcke mit jeweils 32 Shader-ALUs, eigenen Schedulern, Dispach-Ports und Register-Files unterteilt sind. Der Aufbau erinnert stark an AMDs aktuelle GCN-Technik (Graphics Core Next), die seit 2011 verwendet wird.

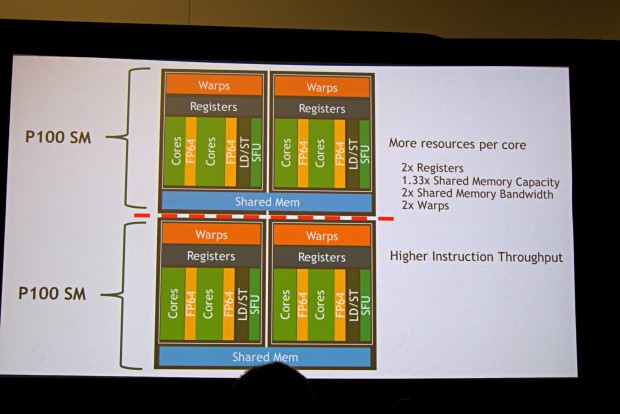

Verglichen mit der Maxwell-v2-Architektur fällt beim GP100-Chip auf, dass Nvidia die Anzahl der ALUs pro Streaming Multiprocessor halbiert hat. Dadurch verdoppeln sich pro Shader-Einheit die verfügbaren Ressourcen wie der Warp-Scheduler, das Register-File und die interne Bandbreite. Der gemeinsame Speicher der ALUs fasst 64 statt 96 KByte, allerdings greifen auf diesen 64 statt 128 Einheiten zu - das macht ein Drittel mehr Shared Memory pro Rechenwerk. Unterm Strich kann der GP100 also mehr Daten lokal vorhalten und schneller abarbeiten, sodass die Geschwindigkeit pro ALU und Takt steigt.

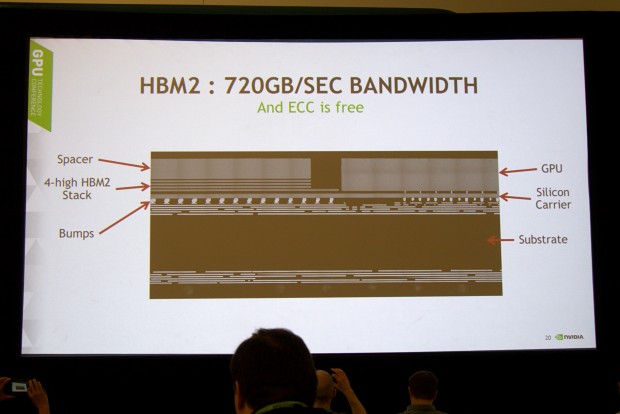

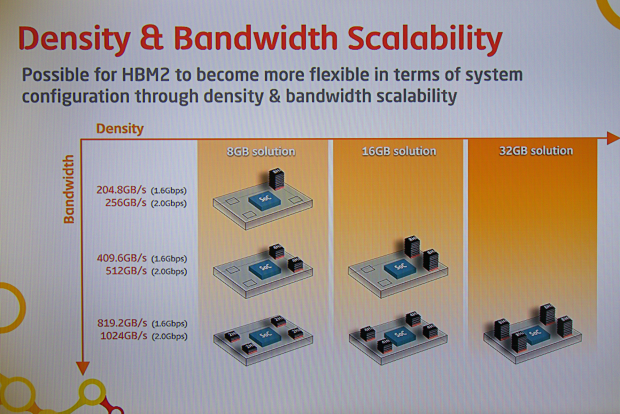

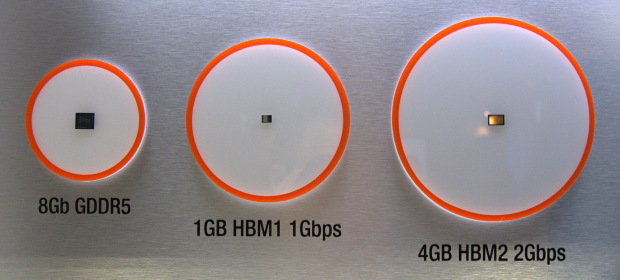

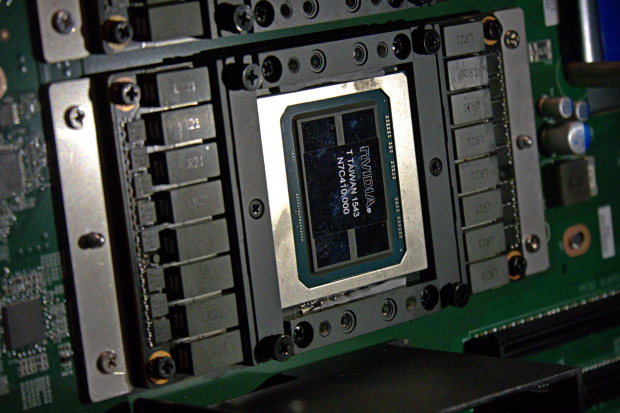

Um Informationen zum Grafikchip und dessen internen Speichern zu transportieren, hat Nvidia dem GP100 ein Speicherinterface für High Bandwidth Memory spendiert. Die Tesla P100 nutzt 16 GByte HBM2 in Form von vier 4-Hi-Stacks. Die takten mit rund 1,4 GHz und hängen jeweils an einem 1.024 Bit breiten Interface, was eine Datentransfer-Rate von 720 GByte pro Sekunde ergibt. Mittelfristig dürfte die Karte jedoch mit doppelt so viel Videospeicher ausgerüstet werden, was Nvidia beim Design berücksichtigt hat.

Der 4-Hi-HBM2 ist flacher als der GP100-Chip, weshalb ein Spacer beide Dies auf die gleiche Höhe bringt. Bei AMDs Fury X gleicht schlicht Wärmeleitpaste die geringfügig unterschiedliche Bauhöhe aus. Auch wenn SK Hynix oder Samsung 8-Hi-Stacks mit 8 statt 4 GByte Kapazität liefern können und Nvidia die Tesla P100 aktualisiert hat, bleibt der der Spacer gleich, da das Package bei HBM2 auch mit 8Hi gleich hoch ausfällt. Beide Speicherhersteller geben an, 8-Hi-Stacks ab Ende 2016 in Serie produzieren zu wollen. Da die Beschleunigerkarte aber so schnell keinen Nachfolger erhalten dürfte, bleibt ausreichend Zeit eine Version mit verdoppeltem Videospeicher nachzuschieben - zuletzt ging Nvidia bei der Quadro M6000 ähnlich vor.

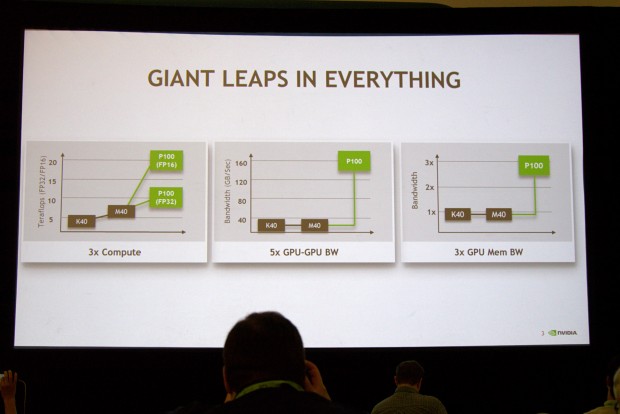

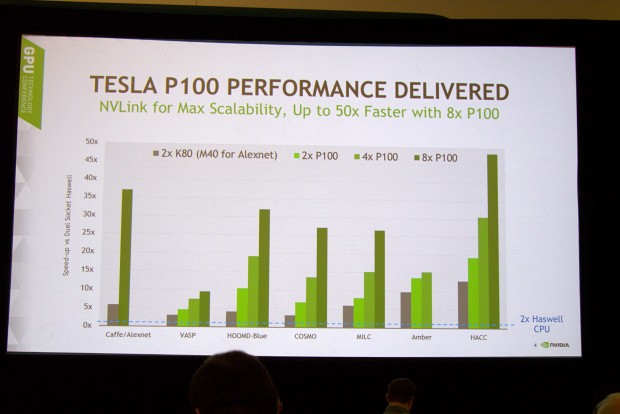

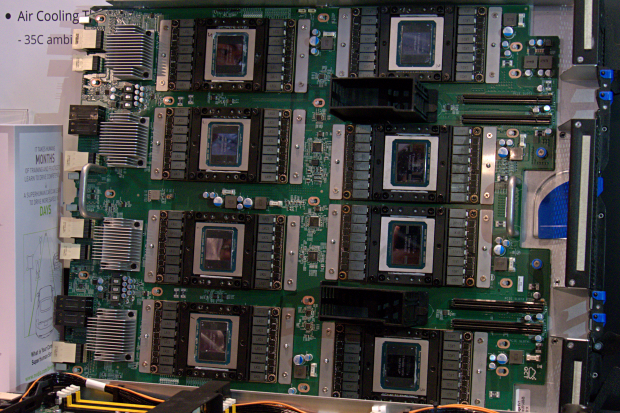

Erste Messungen zur neuen Tesla P100 legte Nvidia ebenfalls vor: Abseits theoretischer Zahlenspielchen, die keine architektonischen Verbesserungen berücksichtigen, zeigte der Hersteller Messwerte mehrerer Karten. Zwei Tesla P100 schlagen demzufolge zwei Tesla K80 durchweg. Das ist durchaus spannend, denn auf jeder K80 sitzen zwei GK210-Chips. Diese GPUs hat Nvidia für den HPC-Markt mit vergrößerten Registern und Caches ausgestattet. Die Tesla K80 basiert allerdings auf der zwei Generationen alten Kepler-Architektur.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

Wenn du Aufrüstbedarf hast und weisst wann die neuen Karten kommen und was sie können...

Ach ja, lang lang ist es her, da habe ich auch einen Vobis Highscreen Rechner mein...