ScreenAvoider: Lernfähige Selbstzensur zum Schutz der Privatsphäre

Durch Fotos von Bildschirmen können ungewollt vertrauliche Informationen verbreitet werden. US-Forscher schlagen nun ein mehrstufiges System vor, das die Art der Inhalte erkennen soll. Denn einfach nur Displays auszublenden, sehen sie nicht als sinnvolle Lösung an.

Unter dem Namen ScreenAvoider haben US-Wissenschaftler ein System beschrieben, das dabei helfen soll, die Privatsphäre zu schützen. Diese sehen sie vor allem durch Fotos von Bildschirmen aller Art gefährdet. Die Forscher beziehen sich dabei ausdrücklich auf Lifelogging-Geräte und andere Wearables wie Google Glass. Diese könnten, wie die Wissenschaftler in ihrer Arbeit (PDF) beschreiben, immer öfter auch Bildschirme von fremden Personen abfotografieren.

- ScreenAvoider: Lernfähige Selbstzensur zum Schutz der Privatsphäre

- Deep Learning erkennt immer mehr Bilder

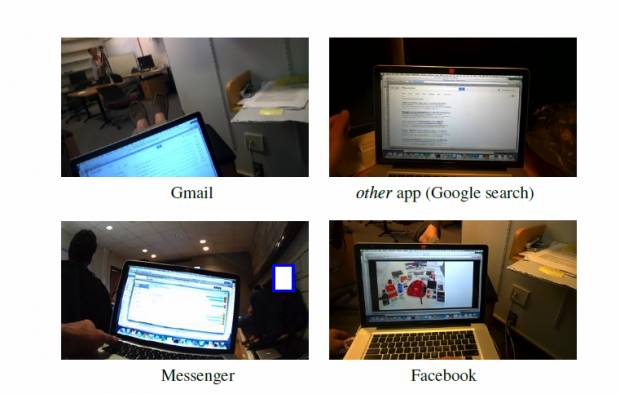

Der Nutzer der Geräte ist sich also nicht einmal bewusst, dass er möglicherweise vertrauliche Daten durch eine Übertragung in die Cloud verbreitet. Daher reicht es nun auch nicht mehr aus, einfach nur jedes Bild eines Displays zu löschen - ein bestimmtes Foto eines Bildschirms kann vom Nutzer ja ausdrücklich erwünscht sein.

Vielmehr müssen die Algorithmen, welche die Bilder auswerten, auch den Inhalt einer Computerdarstellung erkennen können. Dafür lassen sich dann Regeln festlegen, zum Beispiel in der Art von: Fotos von Spielen sind ok, Bilder von E-Mails nicht. Dafür ist eine komplexe Auswertung der Bildinhalte nötig, die unter anderem von GPUs in der Cloud erledigt werden soll.

Dort sollen die Bilder dann umgehend gelöscht werden, zumindest dem ersten Speicherort in der Datenwolke muss man also trauen. Um das zu stärken, sollen Bilder nur verschlüsselt übertragen werden. Die Forscher weisen in ihrer Arbeit auch ausdrücklich auf die Privatfotos hin, die kürzlich aus Apples iCloud gestohlen wurden.

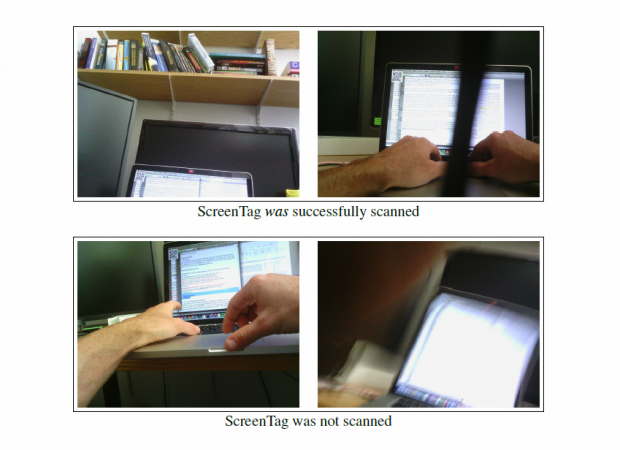

Erschwert wird die Bilderkennung bei Fotos von Wearables bisher durch deren geringe Auflösung, hohe Kompression und die oft verzerrte Perspektive. Als ein Beispiel für ein falsch erkanntes Bild zeigen die Wissenschaftler ein Foto eines Schriftstücks, das der Vollbilddarstellung eines Dokuments auf einem Computermonitor ähnelt. Der Inhalt kann zwar harmlos sein, aber um vertrauliche von öffentlichen Informationen zu unterscheiden, ist eine Analyse des Kontextes der Inhalte nötig.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

| Deep Learning erkennt immer mehr Bilder |

- 1

- 2

Und dass die Bilder nicht erst in die Cloud-GPU geladen werden müssen!

...wie nah muss so eine Kamera wohl an dem abfotografierten/gefilmten Bildschirm dran...

Von all dem Schwachsinn den ich in den letzten Jahren so gehört habe steht das definitiv...

Vor allem bei dem Thema Privatsphäre schaltet mein Gehirn bei dem Schlagwort "US...