Bilderkennung: Computer beschreibt Bild

Was ist auf einem Bild zu sehen? Zwei Entwicklerteams in den USA haben Verfahren entwickelt, um Bilder automatisch zu erkennen und zu beschreiben. Das ist nützlich für die Bildersuche, kann aber auch ganze andere Auswirkungen haben.

Googles Bildersuche achtet eher auf Texte neben Bildern als auf die Bilder selbst. Das soll sich ändern: Zwei Entwicklerteams haben Lösungen gefunden, mit denen Computer Bilder erkennen und sie beschreiben können.

Eines der Teams ist von Google, das andere von der Stanford-Universität in Kalifornien. Beide haben einen ähnlichen Ansatz gewählt: Sie kombinieren Verfahren aus der Bildverarbeitung und der Verarbeitung der natürlichen Sprache.

Software imitiert Gehirn

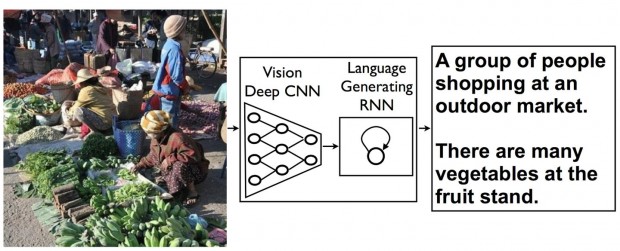

Beide Gruppen setzen dabei auf neuronale Netze. Künstliche neuronale Netze (KNN) sind Computerprogramme, die von der Funktionsweise des menschlichen Gehirns inspiriert sind. Sie können lernen, Muster zu erkennen. Jeder Ansatz verknüpft zwei dieser neuronalen Netze.

Die Google-Entwickler nehmen ein Convolutional Neural Network (CNN), das darauf trainiert wurde, Objekte auf Bildern zu erkennen. Das CNN analysiert ein Bild und leitet das Ergebnis an ein rückgekoppeltes oder rekurrentes neuronales Netz (RNN) weiter. Das erstellt eine Beschreibung des Bildes. Das Konzept der Stanford-Gruppe ist damit vergleichbar.

Computer lernen Bilder erkennen

Die Forscher haben ihre Systeme zunächst angelernt. Dazu haben sie sie jeweils mit einer relativ kleinen Menge an Bildern gefüttert, die mit einer Beschreibung versehen waren. Die Algorithmen lernten, Muster auf Bildern und in Beschreibungen zu erkennen. Dann wurden sie auf größere, öffentlich zugängliche Datenbestände, darunter Flickr8K und Flickr30K, angesetzt.

Die Systeme liefern einfache Bildunterschriften wie "Schwarz-weißer Hund springt über ein Hindernis" oder "Eine Gruppe junger Leute spielt Frisbee". Das mag nicht sehr kreativ sein, reicht aber als Beschreibung durchaus.

Bilder werden automatisch und genau in Worte übersetzt

"Ein Bild mag mehr sagen als tausend Worte", schreiben Oriol Vinyals, Alexander Toshev, Samy Bengio und Dumitru Erhan im Google Research Blog. "Aber manchmal sind die Wörter das Nützlichste. Deshalb ist es wichtig, dass wir Möglichkeiten finden, um Bilder automatisch und genau in Worte zu übersetzen."

Die neuen Algorithmen können dafür genutzt werden, Millionen von Bildern und Videos im Internet zu beschreiben und damit auffindbar zu machen. Außerdem könnten sie beispielsweise Sehbehinderten oder Robotern bei der Navigation helfen. Sie könnten aber auch für die Überwachung eingesetzt werden, warnt die New York Times: Überwachungskameras könnten dann nicht nur Gesichter, sondern auch Verhaltensweisen erkennen.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

+1

01.12.2016 11:30; Person, mitte 40, weißes hemd, schwarze hose, hat smartphone in Hose...

+1

Hahahahahaha :D Ich musste gerade so laut lachen als ich deinen Kommentar gelesen habe...