Intel

Anti-Aliasing per CPU mit hohem Tempo

Für seine bereits seit 2009 verfolgte Technik des Anti-Aliasing auf CPU-Kernen hat Intel nun neue Beispielprogramme veröffentlicht. Sie sollen zeigen, dass das Verfahren die Bildrate von Spielen kaum beeinflusst.

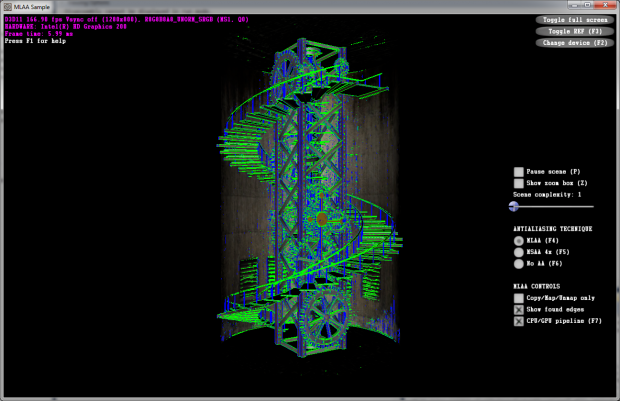

Intel bezeichnet seine Technik, die allein per Software realisiert wird, als "morphologisches Anti-Aliasing" (MLAA). Es funktioniert genau so, wie die von AMD seit der Serie Radeon 6800 verfügbare Funktion: Die Kantenglättung findet nicht am Ende der Rendering-Pipeline einer GPU statt, sondern wird auf das fertige Bild angewandt. Qualitativ ist MLAA anderen Verfahren überlegen, die damit behandelten Szenen wirken wie mit einem leichten Weichzeichner versehen. Auf Monitoren mit hoher Pixeldichte wirken sie dennoch scharf.

Bereits 2009 hatte Alexander Reshetov von Intel das Verfahren, das sich auch auf Prozessoren realisieren lässt, in einer ausführlichen Arbeit beschrieben (PDF). Nun haben die Grafikforscher es an die aktuellen Versionen von Intels Programmierbibliothek TBB angepasst und weiter für die Verwendung von SSE-Befehlen optimiert. Obwohl die Codebeispiele auch für Sandy-Bridge-Prozessoren vorliegen, werden deren AVX-Erweiterungen noch nicht erwähnt.

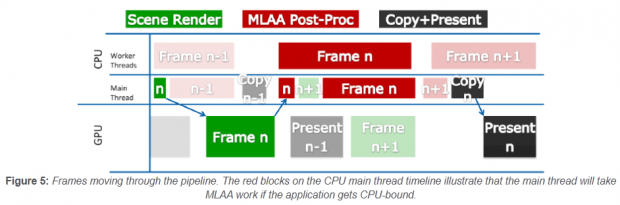

Ganz ohne GPU kommt jedoch auch Intels MLAA nicht aus, schließlich müssen die Bilder über die Displayanschlüsse der Grafikeinheit wieder ausgegeben werden. Daher werden die Farbwerte der Szene nach dem Rendering zur CPU kopiert, dort gefiltert, und anschließend wieder an die GPU übergeben. Diese Transfers brauchten Zeit, das eigentliche MLAA aber kaum, behauptet Intel.

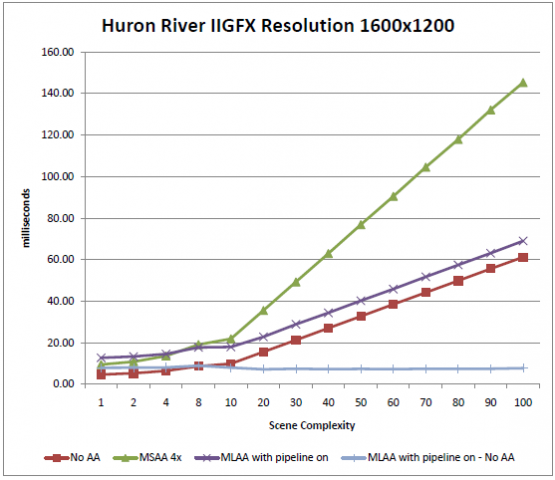

In einem Vergleich zwischen der gebräuchlichsten Form der Glättung, dem Multi-Sample Anti-Aliasing (MSAA) und MLAA kommt Intel zu dem Schluss, das MSAA und MLAA bei bis zu achtfacher Filterung gleich schnell sind. Danach steigt der Bedarf an Rechenzeit für MSAA aber stark an, der von MLAA weit weniger stark. Das gilt freilich nur, wenn mindestens ein Core der CPU nicht für andere Aufgaben verwendet wird.

Da MLAA zudem nicht von der Komplexität der 3D-Szene abhängig ist, bleibt der Aufwand an Rechenleistung kalkulierbar: Es wird stets das fertig gerenderte Bild behandelt, wobei der Bedarf dafür nur von dessen Auflösung abhängt. Interessant wird die Technik damit auch für Geräte, deren Grafiklogik kein Anti-Aliasing per Hardware beherrscht.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

ja, aber die poste ich doch nicht hier im golem forum, sonst bringt mich noch jemand mit...

Bei Intels verfahren hingegen, wird weder Multisampling betrieben noch SSAA, es wird...

gut ... also weiterhin sinnloses, nun gepaart mit Erfundenem. Somit fällt die Sache auf 0...

hab ich mir auch gedacht.