Fraunhofer Institut baut Spracherkennung in Second Life ein

Demo-Getränkeroboter per Telefon bedienbar

Als Experiment haben Forscher des Fraunhofer Instituts für Produktionstechnik und Automatisierung eine hauseigene Programmierschnittstelle in Second Life eingebaut. Sie waren dann in der Lage, ihren Avatar per Telefon zu steuern.

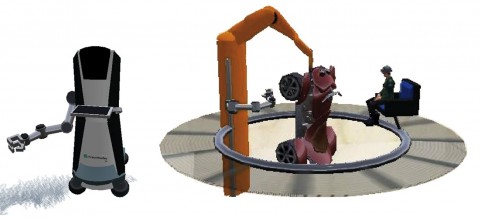

Es ist gar nicht so schwierig, Sprachsteuerung in beliebige Anwendungen zu integrieren - sagen jedenfalls die Forscher des Fraunhofer Instituts für Produktionstechnik und Automatisierung in Stuttgart. Um ihre These zu beweisen, haben sie innerhalb weniger Tage ein intern entwickeltes Spracherkennungssystem "Fraunhofer Voice Control API" in die virtuelle Welt Second Life eingebaut. Jetzt servieren Roboter auf der Dachterrasse eines Hochhauses Getränke - der User bestellt seinen virtuellen Cocktail per Telefon. Das API wird wie ein Webservice angesprochen und überträgt dann die Kontrolle über das Sprachdialogsystem an das Anwendungsprogramm.

Ein weiteres Experiment in Second Life: Der Benutzer setzt sich auf einen Industrie-Montage-Stuhl und wählt eine eingeblendete Telefonnummer. Anschließend kann er den Stuhl per Sprache steuern und so Aktionen auslösen. "Wir wollten damit zeigen, wie einfach und schnell Spracherkennung heutzutage in bestehende Anwendungen integriert werden kann", sagte Daniel Wimpff, wissenschaftlicher Mitarbeiter am Fraunhofer IPA. "Die Entwicklung der Demonstratoren beanspruchte nur wenige Tage."

Die virtuelle Fabrikwelt ist öffentlich zugänglich, so dass sich Interessierte nach Installation der Clientsoftware von Second Life darin umschauen können. Für die Exponate mit Spracherkennung ist jeweils eine Telefonnummer zum Festnetztarif erreichbar.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

Ähm? Immerhin ist es ein Weltweit groß anerkanntes Institut! Und nicht nur das, auch...

Ich habe SL nur als Medienhype mitbekommen. Alle schreiben darüber, also muss es gut...