Supercomputer: Wie die Exaflop-Marke geknackt werden soll

Ist Moore's Law am Ende? Das Erreichen der Exaflop-Marke scheint für Hersteller von Supercomputern nicht so einfach zu sein. 2020 soll eine solche Maschine installiert sein - ein spannender Wettbewerb auf dem Weg zum Exascale-Computing ist bis dahin sicher.

Exascale-Computing ist bedeutsam - eine Meinung, die auch Barack Obama teilt. Mit einer Executive Order unterstrich der Präsident der Vereinigten Staaten unlängst ganz offiziell die Bedeutung des Themas. Ein solches Dekret ist kein Gesetz und mit keinem Förderprogramm verbunden.

- Supercomputer: Wie die Exaflop-Marke geknackt werden soll

- An der Effizienz hapert es noch

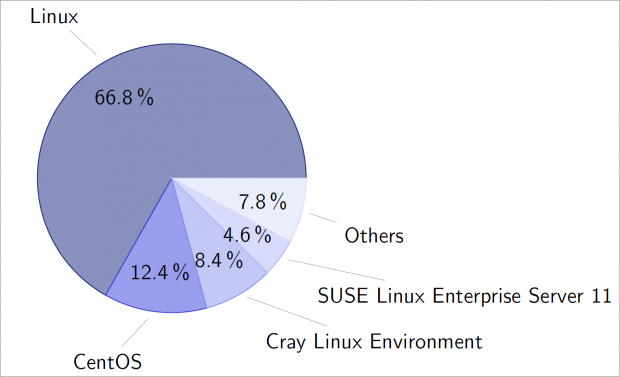

- Ohne Linux läuft kaum etwas

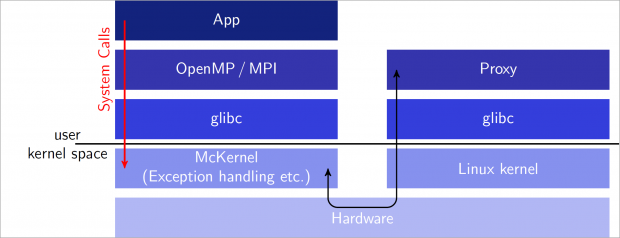

- McKernel für Supercomputer

Es führt den Verwaltungsbeamten aber die Bedeutsamkeit des Hochleistungsrechnens vor Augen. Zudem verlangt es koordiniertes Handeln, um den durch das Hochleistungsrechnen erzielten ökonomischen und wissenschaftlichen Erfolg zu maximieren. Doch was sind die Ziele des Exascale-Computings und welche Herausforderung sind auf dem Weg dorthin zu bewältigen?

10^18 Fließkommaoperationen pro Sekunde

Exascale bedeutet, dass ein System 10^18 Fließkommaoperationen pro Sekunde (Flops) durchführen kann. Diese gewaltige Anzahl von Operationen dient etwa der Simulation von Tsunamis und Sturmfluten - Naturkatastrophen, die in der Regel immense Schäden nach sich ziehen.

Das Tohoku-Erdbeben im Jahr 2011 forderte in Japan 18.000 Menschenleben, der ökonomische Schaden wird auf 195 bis 305 Milliarden US-Dollar geschätzt. Ein adäquates und genaues Vorhersagemodell könnte die Folgen solcher Naturkatastrophen mindern, doch die notwendige Rechenleistung hierfür kann nur ein Hochleistungssystem erbringen.

Die Prozessoren werden immer schneller, die Anzahl der Rechnerknoten innerhalb eines Clusters steigt weiter an. Das Erreichen der Exaflop-Marke (nach Erreichen der Peta- und Teraflop-Marke) scheint dennoch nicht ganz einfach zu sein. Technisch gesehen sind grundsätzlich drei Herausforderungen zu lösen.

Herausforderungen für das Erreichen der Exaflop-Marke

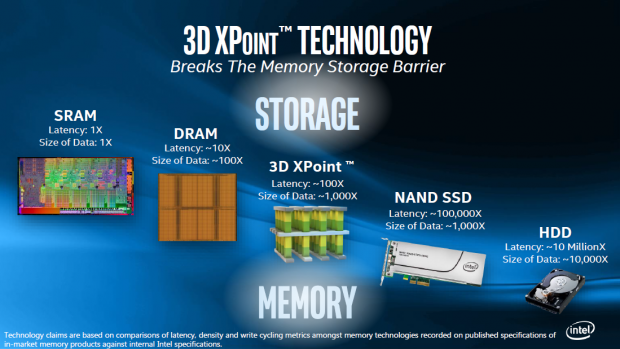

Moore's Law scheint sich zumindest zu verlangsamen, wenn nicht sogar auszulaufen. Das bedeutet implizit, dass die Beschleunigung der Prozessoren durch größere Caches oder mehr Kerne an ihre Grenzen stößt. Spezialisierung - also die Verwendung von GPUs oder die Integration von breiteren Vektoreinheiten - scheinen der favorisierte Lösungsweg zu sein. Allerdings steigt die Komplexität der Programmierung stark an.

Früher waren die Systeme homogen, heute besteht beispielsweise das Titan-System vom Oak Ridge National Laboratory aus 18.688 Rechenknoten mit insgesamt 29.908 Opteron-Kernen und 18.688 Nvidia-GPUs. Der Entwurf skalierender Programme, die das komplette, heterogene System ausnutzen, ist eine große Herausforderung. Ganz plakativ ist das aus den Ergebnissen des Linpack-Benchmarks aus der Top 500 abzulesen: So erzielt das System nur einen Wert von 17,5 Petaflops, während der theoretische Höchstwert bei 27,1 Petaflops liegt.

Im Vergleich zu klassischen, homogenen Systemen ist das Verhältnis schlecht: Stuttgarts Hazel Hen erzielt beispielsweise ein Verhältnis von 5,6 zu 7,2 Petaflops. Bei Nicht-x86-Systemen sieht es meist noch besser aus - der japanische K-Computer mit Sparc64-Prozessoren kommt auf ein Verhältnis von 10,5 Petaflops zu 11,3 Petaflops.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

| An der Effizienz hapert es noch |

Müssten Änderungen an Linux nicht zurückgeführt werden, wäre Linux jetzt da, wo Unix...

halten wir uns echt noch an diesem Schwachsinn auf? Das Kind ist doch schon längst in den...

Ich vermute ja eher, dass dabei auf verteiltes Rechnen gesetzt wird. Einmal pro Monat...

Richtig. Fast richtig. Moores Feststellung lautete "The complexity for minimum...