Pascal GP100: Nvidias Grafikchip besteht aus 15 Milliarden Transistoren

15,3 Milliarden Transistoren auf 610 mm² Chipfläche im 16FF-Prozess und 3.840 Shader-Einheiten mit 16 GByte HBM2-Speicher: Nvidia hat den GP100-Grafikchip mit Pascal-Technik vorgestellt.

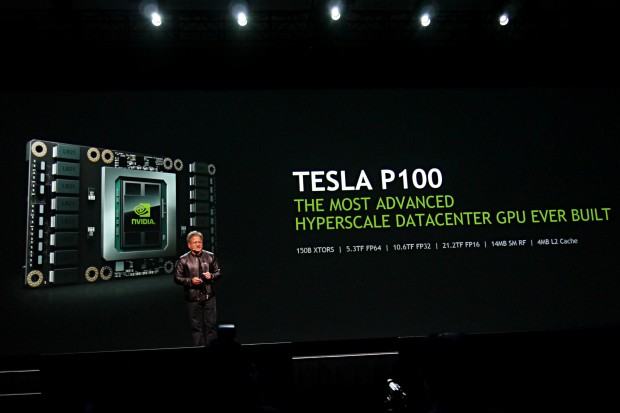

Nvidia-Chef Jen-Hsun Huang hat auf der Keynote der GPU Technology Conference 2016 in San Jose, Kalifornien, den GP100-Grafikchip samt der Tesla-P100-Beschleunigerkarte angekündigt. Die auf der Pascal-Architektur basierende Tesla P100 erreicht eine Geschwindigkeit von 10,6 Teraflops bei einfacher Genauigkeit (FP32), was für Spiele wichtig ist. Die für wissenschaftliche Anwendungen relevante FP64-Performance (doppelte Genauigkeit) gibt Nvidia mit 5,3 Teraflops an - das Verhältnis 2:1 gab es bisher nur bei AMD.

Der GP100-Chip wird im 16FF-Prozess bei der TSMC gefertigt und besteht aus 15 Milliarden Transistoren. Zum Vergleich: Nvidias aktueller GM200 der Titan X integriert 8 Milliarden Transistoren und AMDs Fiji der Fury X 8,9 Milliarden Transistoren. Die Die-Fläche des GP100 gibt Nvidia mit enormen 610 mm² an, was etwas größer als der GM200 (601 mm²) und der Fiji (596 mm²) ist. Der Chip soll sich bereits in der Serienfertigung befinden, was angesichts der Maße erstaunlich ist. Fragen zur Yield-Rate wollte Nvidia nicht beantworten.

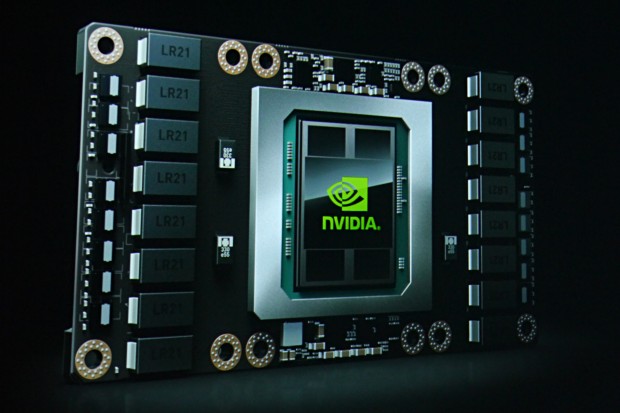

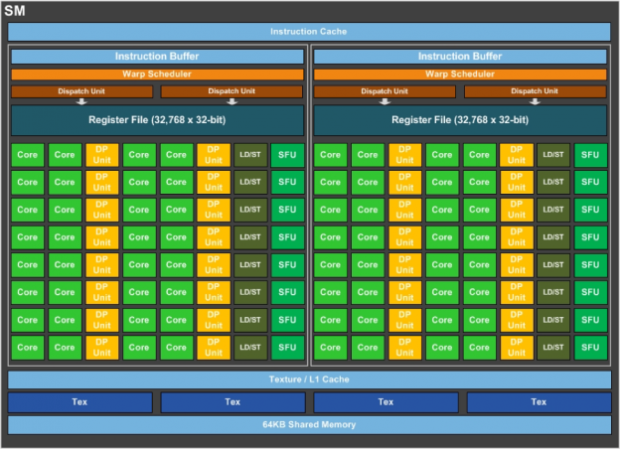

Die Basis für den neuen GP100 bilden sechs Graphics Processor Cluster (GPC). Jeder enthält fünf Texture Processor Cluster (TPC) mit zwei Streaming Multiprocessors (SMP) mit 64 Shader- und 40 Textur-Einheiten, was an AMDs GCN erinnert. Insgesamt bietet der Chip ergo 3.840 ALUs und 240 TMUs, der L2-Cache fasst 4 MByte. Hinzu kommen 15,36 MByte an Register-Speicher für schnelle On-Chip-Berechnungen. Das Speicherinterface ist 4.096 Bit breit und nutzt High Bandwidth Memory (HBM2), der mit auf einem Interposer sitzt.

Für die Tesla P100 schaltet Nvidia 3.584 Shader-Einheiten frei und taktet sie mit 1.328 MHz Basis- und 1.480 MHz Boost-Frequenz. Daraus resultieren 21,2 Teraflops bei halber Genauigkeit (FP16). Bei einfacher Genauigkeit (FP32) sind es 10,6 Teraflops und bei doppelter Genauigkeit (FP64) noch 5,3 Teraflops. Nvidia verbaut FP32-Einheiten, die pro Takt zwei FP16-Berechnungen durchführen können, und dedizierte FP64-ALUs. Das 4:2:1-Verhältnis ist untypisch, bisherige Nvidia-Architekturen beherrschen bis zu 3:1 für FP32/FP64. Nicht beschleunigt ist INT8, also Integer mit acht Bit Genauigkeit, was andere Pascal-Chips bei vierfacher FP32-Geschwindigkeit ausführen können (sofern freigeschaltet).

Am 4.096-Bit-Interface hängen 16 GByte HBM2 von Samsung. Die vier Stacks liefern eine Datentransfer-Rate von 720 GByte pro Sekunde. Das entspricht rund 1,4 GHz - HBM2 schafft allerdings bis zu 2 GHz. Da die Tesla P100 allerdings keinen GP100-Vollausbau nutzt, ist eine gedrosselte Speichergeschwindigkeit sinnvoll, um die 300 Watt TDP einzuhalten.

Vorerst erhalten Cloud-Plattform-Anbieter Zugriff auf die Tesla-P100-Karten, einzelne Hersteller folgen im ersten Quartal 2017. Ein auf dem GP100 basierendes Geforce-Modell hat Nvidia nicht angekündigt.

Oder nutzen Sie das Golem-pur-Angebot

und lesen Golem.de

- ohne Werbung

- mit ausgeschaltetem Javascript

- mit RSS-Volltext-Feed

Das Problem ist heutzutage halt, dass der Speicher zum Nadelöhr wird. 4K, 8K und HDRI...

Cloud-Plattform-Anbieter erhalten die Karten nur? Da die meisten Clouds ja auf Linux/Unix...

Das ist ein treffender Vergleich. Viele Online Shops haben die Angabe zum Speicher in den...

ach deswegen gibts den dgx1 mit 8 tesla p100 die per pcie and 2 xeons angebunden sind...